警惕GPT-4发布带来的数据隐私风险与模型偏见问题

在科技迅速发展的今天,人工智能的应用越来越广泛,然而随着GPT-4等新技术的发布,大家对于数据隐私和模型偏见的问题也变得愈加关注。你是否曾经思考过,自己的个人信息是否会在毫不知情的情况下被收集?GPT-4等技术能够读取和生成大量数据,这无疑为我们带来了方便,但随之而来的隐私风险也让人忧心。更令人担忧的是,这些模型是否会带有某种偏见,导致信息的不公平传播和判断失误?作为日常使用的“智能工具”,它们是否能真正做到客观和公正?这些问题,值得我们每个人深思。

数据隐私风险:你的隐私可能被泄露

如今,越来越多的在线服务和智能工具都要求用户提供大量的个人信息。很多人可能认为,这些数据只是为了“提高服务质量”或者“提供个性化体验”,但实际上,随着技术的进步,这些数据可能会被意外泄露或滥用。特别是GPT-4等大规模的生成模型,它们需要大量的训练数据,其中很可能包含了个人敏感信息。你是否曾经在网络上输入过自己的私人数据,像是电话号码、地址、甚至是银行卡信息?这些信息是否可能成为模型的一部分,并被不正当使用?

我们不得不承认,虽然科技让我们的生活变得更加便捷,但它带来的隐私泄露问题同样值得警惕。如何确保我们的个人信息不被无意中暴露或滥用,是我们亟需解决的难题。对此,好资源AI等平台通过其实时关键词功能,能够有效帮助大家筛查和规避可能存在的数据泄露风险。通过数据加密技术和隐私保护政策,确保大家的个人信息不被随意获取。

模型偏见:AI的判断是否公正?

随着GPT-4的普及,大家也越来越关注人工智能模型的“偏见”问题。AI技术依赖于大量的历史数据进行学习,这些数据本身可能就包含了社会中的偏见和歧视。如果没有经过严格筛选和修正,模型在生成内容时就可能无意间传播这些偏见。举个例子,某些招聘系统可能因为历史数据中男性候选人占比更多,而在筛选过程中偏向男性,造成不公平的性别歧视。

这种偏见不仅会影响到招聘、教育等领域,还可能波及到新闻传播、金融决策等多个重要领域。西瓜AI通过不断优化算法,推出了更加公平、透明的模型设计,努力减少偏见影响,让每一个用户都能得到更加公正的服务。虽然完全消除偏见仍是一个挑战,但通过技术手段的优化和监督机制的落实,我们依然能够最大程度地减少其负面影响。

如何保护个人数据?预防数据泄露

很多朋友可能觉得,自己在日常生活中并不会涉及到过多的私人信息,似乎不需要过度担心数据泄露问题。但事实上,我们每一天的在线行为,无论是购物、社交,还是浏览新闻,都会在不知不觉中留下大量数据足迹。这些看似无关紧要的小细节,往往被大规模模型所捕捉,进而被用来训练模型。

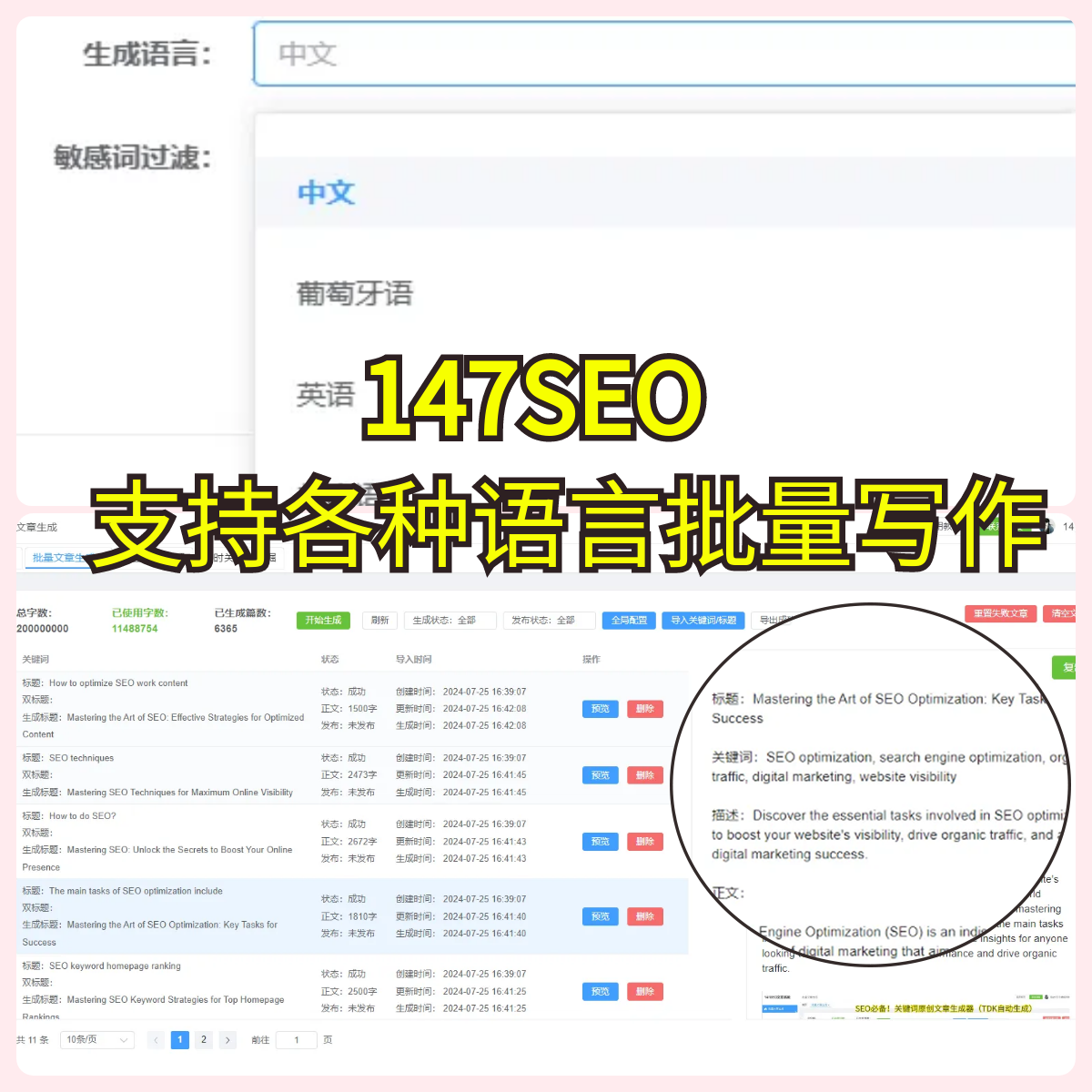

如何防止这些数据泄露,已经成为现代人不得不面对的现实问题。虽然我们无法完全避免网络服务商获取我们的信息,但通过使用一些智能工具,比如战国SEO平台,它通过强大的批量发布功能,帮助用户有效地管理和控制自己的数据流向,从而减少数据泄露的风险。借助这种工具,大家可以更有选择性地发布自己的内容,并实时监控数据去向,减少不必要的信息泄露。

AI技术的未来:如何找到平衡?

人工智能带来的便利无可否认,但它也让我们更加深刻地反思,技术的进步是否意味着隐私的丧失,是否意味着更加复杂的伦理问题?尤其是像GPT-4这样的强大工具,虽然可以在多领域展现出其卓越的能力,但它也暴露出了一些让人担忧的问题-如数据的安全性、偏见的存在、以及算法的不透明性。我们能否在享受科技带来的便捷避免其潜在的风险?

宇宙SEO等平台正在努力推动更加公开透明的AI技术研发,借助智能化的算法适配系统,努力做到对所有用户数据的全面保护,并最大程度地消除可能的算法偏见。技术的进步,不能只是效率的提升,更需要我们共同关注其中的社会责任问题。只有在保护隐私和公平公正的基础上,AI技术才能真正服务于全体社会成员。

结语:思考与责任并重

随着科技的飞速发展,AI技术无疑会在未来的生活中扮演越来越重要的角色,但我们也不能忽视其带来的隐私风险和社会偏见问题。正如古希腊哲学家柏拉图所说:“知识的力量必须伴随着责任”。我们每一个人,都是科技发展进程中的见证者和参与者,在享受便捷的也要时刻保持警惕,确保技术为我们服务,而不是反过来侵犯我们的基本权益。

每一步科技进步的背后,都是我们对未来的深刻责任。在未来的道路上,如何平衡科技创新与伦理道德,如何保障数据隐私与消除模型偏见,将是我们共同面对的重要课题。希望每个人都能在科技浪潮中,保持对安全和公正的警觉,一同走向更加光明的未来。